En un entorn de LAN Party, el xatbot és l’eina principal d’atenció a l’usuari. Si el servei cau, l’experiència dels participants es degrada. Tot i que treballem amb eines al núvol com Google Colab i GitHub, existeixen riscos crítics que hem de mitigar:

- Pèrdua de sessió a Colab: Les instàncies de Colab són temporals i s’esborren passades unes hores.

- Errors en el codi: Una actualització mal executada pot trencar la lògica del xatbot.

- Seguretat de les credencials: L’exposició de les claus API (Gemini/OpenAI) podria suposar la suspensió del servei.

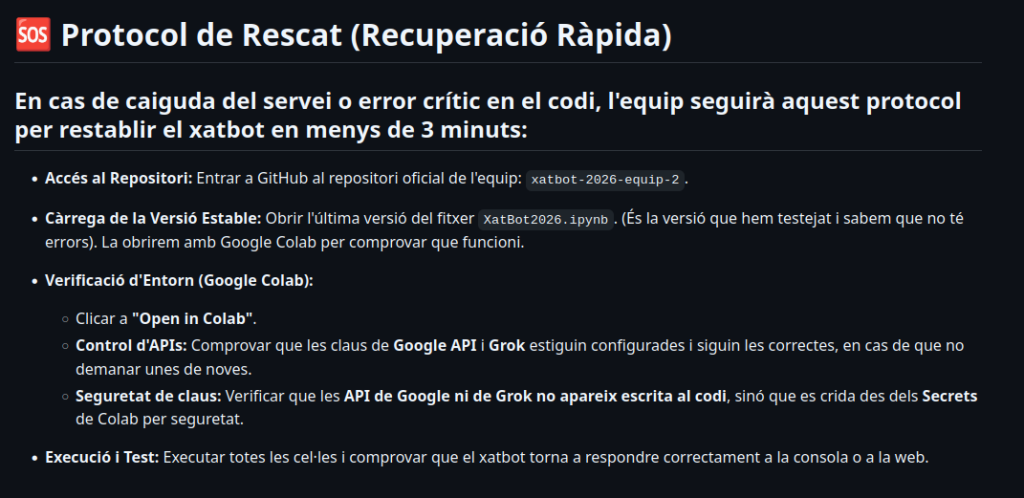

L’objectiu d’aquest pla és establir un RTO (Recovery Time Objective) d’un màxim de 3 minuts. Això fa que en cas que hi hagués una caiguda o error es pogués restablir el servei a l’usuari tan aviat com es pugui.

Hem decidit que la millor manera de mantenir una còpia de seguretat és al mateix GitHub, el codi “font” sempre resideix a GitHub, actuant com a còpia de seguretat externa i permanent.

I com a manual o pla de recuperació es crearà també al GitHub per tenir-ho tot junt, per tant, hi haurà un fitxer “Còpia de seguretat – Última Versió” i “Pla de recuperació”

Perquè el protocol de rescat sigui efectiu, hem establert una rutina de treball rigorosa. La recuperació ràpida només és possible si el repositori de GitHub està actualitzat amb l’última versió funcional del xatbot.

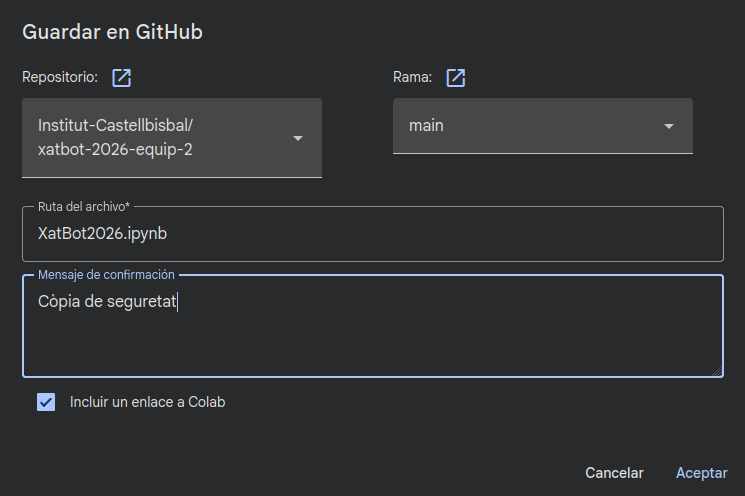

Cada vegada que afegim informació nova al xatbot és obligatori seguir aquest cicle.

- Testejat: Verifiquem que el canvi funciona correctament a Google Colab.

- Commit a GitHub: Utilitzem la funció

Fitxer > Desa una còpia a GitHub - Comentari de versió: Descrivim breument què hem afegit (ex: “Afegida normativa de tornejos”) per saber exactament què estem guardant

Per elaborar aquest pla de manera professional i assegurar-nos que complia amb tots els requisits tècnics de la LAN Party, hem seguit un procés col·laboratiu dividit en tres fases.

1 – Disseny i Consultoria amb IA

Hem utilitzat la IA (Gemini) com a consultor tècnic. El procés no ha estat “copiar i enganxar”, sinó que hem mantingut un diàleg per identificar riscos, la IA ens ha ajudat a veure que el perill no era només que el codi fallés, sinó també la pèrdua de sessions a Colab o la seguretat de les claus API.

2 – Implementació de la Seguretat (Grok i Secrets)

Un dels punts crítics va ser com gestionar les claus de Google i Grok. Amb l’ajuda de la IA, vam aprendre a implementar el sistema de userdata (Secrets) de Google Colab. Això ens permet que:

- Les claus estiguin protegides i no visibles en el codi de GitHub.

- El pla sigui recuperable per qualsevol membre de l’equip.

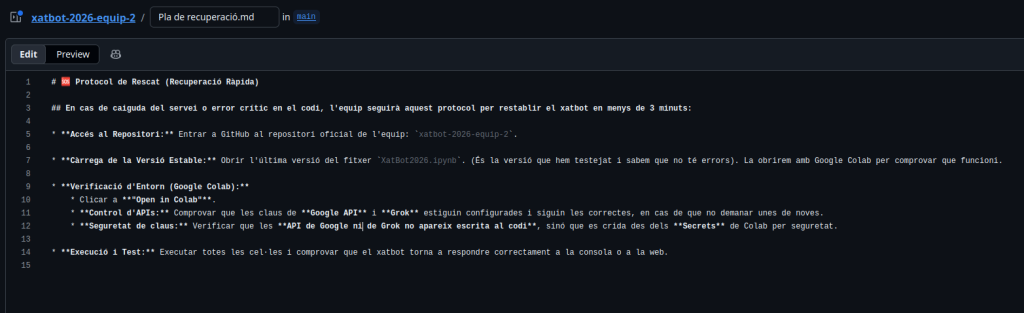

3 – Validació i Redacció del Markdown

Finalment, vam demanar a la IA que ens ajudés a estructurar tota aquesta informació en format Markdown per garantir que el nostre fitxer Pla de recuperació.md fos professional, fàcil de llegir i útil en cas d’emergència real.

Aquest ha sigut el resultat del fitxer del Pla de protecció.

Deixa un comentari